I nuovi iPhone 12 Pro e iPhone 12 Pro Max sono dotati di una tecnologia che per molti non è ancora chiara: il LiDAR. Secondo Apple, è proprio il LiDAR l’arma segreta che spinge il comparto fotografico verso nuovi picchi di eccellenza, consentendo di mettere il target a fuoco più velocemente e potenziando le applicazioni in realtà aumentata con una precisione mai vista prima.

Se sei curioso di conoscere il significato della parola LiDAR, nelle prossime righe troverai tutto ciò che c’è da sapere sulla tecnologia LiDAR ed i suoi campi di applicazione, soffermandoci in particolare sui vantaggi che questo sensore ha sui nuovi iPhone 12 Pro.

Indice:

LiDAR significato e funzionamento

Acronimo di Light Detection and Ranging o Laser Imaging Detection and Ranging, è una tecnica di telerilevamento che consente di misurare la distanza di un oggetto utilizzando impulsi laser, a mo’ di radar, utilizzando un fascio di luce coerente e convogliato invece che delle onde radio.

In pratica, un impulso di luce infrarossa di lunghezza compresa, solitamente, tra i 600 nm e i 1550 nm, viene letteralmente sparato in una direzione: una strumentazione elettronica dedicata provvede poi a calcolare il tempo intercorso tra l’invio e la ricezione dell’impulso riflesso da oggetti come mura, animali o persone. Il raggio si muove alla velocità della luce, e la strumentazione necessaria per la misurazione deve essere estremamente precisa: stiamo parlando infatti di scarti temporali nell’ordine di una manciata di picosecondi, ovvero un millesimo di miliardesimo di secondo, o se preferite, 10-12 secondi.

Il concetto di LiDAR esiste sin dagli anni ’60: una tecnologia che permette di mappare l’ambiente circostante utilizzando raggi laser, registrando il tempo necessario per registrare la loro rifrazione sui vari oggetti presenti, siano essi mobili, mura o persone. Per sottolineare l’importanza del sensore LiDAR, basta pensare che il LiDAR Scanner 3D della missione Apollo 15 ha permesso al modulo di mappare la superficie della luna.

In tempi più recenti, i sensori LiDAR sono utilizzati:

- nelle auto a guida autonoma per determinare pedoni, ciclisti e ostacoli,

- i robot per la pulizia dei pavimenti, in particolare i modelli di fascia alta, i quali mappano gli ambienti e consentono la programmazione e la pulizia di parti delle casa;

- per l’analisi del rischio idrologico e alluvionale;

- per valutare l’accuratezza planimetrica delle città e la pianificazione urbanistica;

- per la silvicoltura, studiando le coperture arboree delle foreste;

- in meteorologia, per misurare la velocità dei venti;

- in astrofisica, per mappare la superficie di Marte tramite il MOLA, Mars Orbiting Laser Altimeter;

- per il controllo della velocità dei veicoli, come alternativa alle pistole radar manuali.

I campi di applicazioni sono limitati soltanto dalla fantasia e dalla creatività di scienziati ed ingegneri, in quanto la tecnologia si apre a tantissimi campi di applicazione.

Differenze tra il sistema LiDAR e ToF

Sugli smartphone, negli ultimi anni, si è sentito spesso il termine ToF, o Time of Flight: si tratta di un sensore per la mappatura 3D simile al LiDAR, ma meno sofisticato. Si tratta di un potente alleato per il calcolo della distanza di persone ed oggetti, e pertanto viene utilizzato per migliorare gli scatti ottenuti. Alcuni modelli dotati di sensore 3D ToF sono:

- Samsung Galaxy S10 5G;

- Samsung Galaxy Note10+;

- Samsung Galaxy S20+;

- Samsung Galaxy S20 Ultra 5G

- LG G8 Thin Q;

- Xiaomi Mi 10;

- Honor View 20;

- Huawei P40 Pro.

Esistono anche altri modelli, ovviamente, ma tutti utilizzano il sensore ToF alla stessa stregua. Il sistema LiDAR equipaggiato su iPad Pro 2020 e iPhone 12 Pro è molto più sofisticato e preciso, nonostante venga utilizzata la medesima tecnologia.

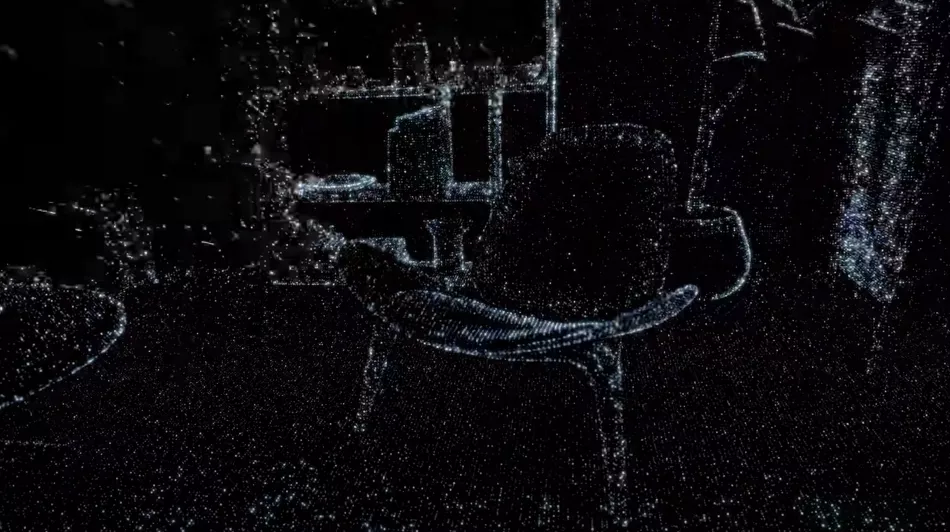

Invece di utilizzare un singolo impulso di luce infrarossa per creare una mappa 3D, come avviene nei sensori ToF, il LiDAR proietta una vera e propria raffica di impulsi laser nell’ambiente circostante, in modo simile a ciò che accade con i sensori necessari per il Face ID.

Come si può osservare dalle immagini, entrambi i sistemi proiettano una serie di punti luminosi nell’ambiente circostante: nel caso specifico, si può osservare il sensore LiDAR di iPad Pro all’opera, mentre a sinistra è il sensore TrueDepth del Face ID di un iPhone di ultima generazione. La tecnica è pressoché simile, l’unica differenza sta nella risoluzione: la mappatura di un ambiente richiede molti meno punti rispetto a quella del volto. Per quest’ultima, l’accuratezza della rilevazione è fondamentale affinché possa essere considerata come sicura.

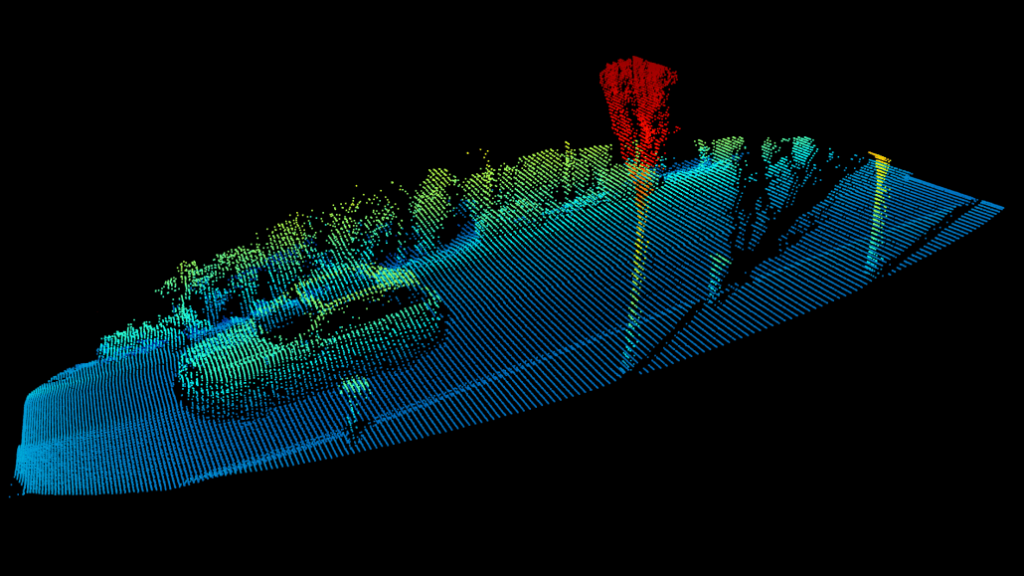

Il sensore LiDAR non vede a colori o in bianco e nero: tutto ciò che produce è una mappa tridimensionale, a seconda degli ostacoli presenti in un ambiente. Durante la presentazione della nuova line-up di iPhone 12, Apple ha mostrato un’astrazione della reale mappatura LiDAR di una stanza comune.

La mappatura non è soltanto merito del sensore LiDAR, ma di un lavoro di gruppo in cui vengono uniti i dati provenienti dalle fotocamere e dai sensori di movimento, i quali vengono analizzati da algoritmi di visione digitale. Il dispositivo provvede poi a realizzare una mappatura completa degli ambienti: è il caso dell’utilizzo delle app più comuni per la realtà aumentata, le quali offrono la possibilità di posizionare oggetti virtuali nello spazio reale.

A cosa serve il LiDAR di iPhone 12

Come abbiamo visto, il sensore LiDAR presente su iPad Pro non è dotato di una risoluzione sufficiente per essere utile a fini fotografici: la sua vera natura è quella di ausilio per la mappatura degli ambienti e per tutte le applicazioni che sfruttano la realtà aumentata. Ma su iPhone 12 Pro e iPhone 12 Pro Max il discorso cambia: il sistema LiDAR aiuta concretamente a realizzare scatti migliori.

In primis, questo è possibile grazie al miglioramento della tecnologia LiDAR, che ora permette di poter proiettare il fascio laser fino a 5 metri di distanza, permettendo una precisione migliore. In seconda istanza, il sistema telemetrico viene ora utilizzata per migliorare l’autofocus, fino a 6 volte più veloce in condizioni di luminosità critiche, e per migliorare gli scatti notturni in modalità Ritratto . Grazie al LiDAR e alla potenza di elaborazione del processore A14 Bionic, anche con una fonte di luce fioca è possibile scattare foto mantenendo colori realistici ed un alto livello di dettaglio.

Non solo foto, ma anche applicazioni in realtà aumentata e giochi AR che potranno sfruttare hardware in grado di mappare gli ambienti in modo accurato.

Un esempio sono quelle applicazioni che permettono un’anteprima degli ambienti posizionando virtualmente degli oggetti in essi, come l’app di Ikea.

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione Dyson Clean+Wash Hygiene: la più agile delle lavapavimenti con qualche compromesso

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo