Nell’era dell’intelligenza artificiale la raccolta e l’utilizzo dei dati sono diventati elementi ancora più cruciali rispetto al passato, poiché alimentano e guidano lo sviluppo di modelli e applicazioni avanzate. Di recente Google, il gigante tecnologico conosciuto anche per le sue innovazioni in campo di IA, ha aggiornato la sua politica sulla privacy per rendere chiaro un aspetto fondamentale: i suoi servizi di IA, inclusi i più recenti come Google Bard e Cloud AI, possono essere addestrati su dati pubblici che l’azienda ha raccolto dal web.

L’azienda ha rivelato che i suoi servizi di traduzione, come Google Traduttore, sono stati addestrati utilizzando informazioni disponibili pubblicamente sul web, mantenendo comunque una trasparenza costante nelle proprie pratiche. L’ultima modifica alla politica sulla privacy amplia questo concetto, includendo anche i servizi più recenti di intelligenza artificiale.

Indice:

Google ha cambiato l’informativa sulla privacy

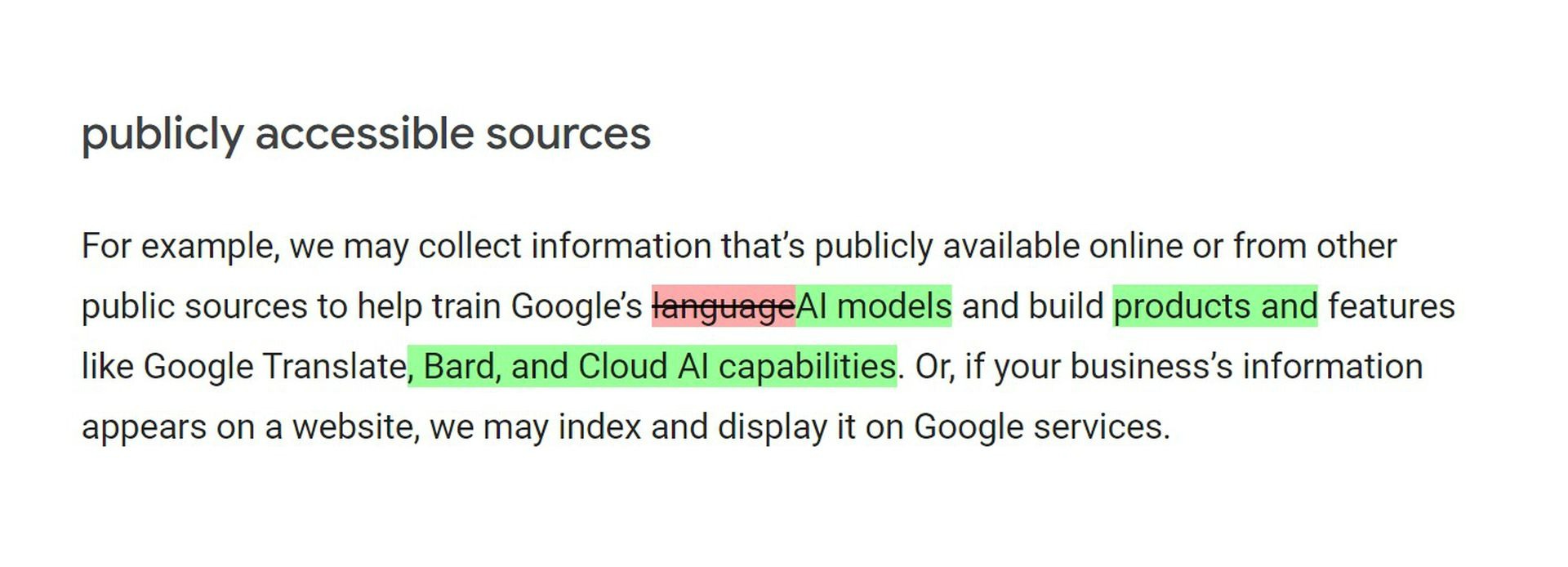

Dopo l’aggiornamento entrato in vigore il 1° luglio 2023, l’informativa sulla privacy di Google ora sottolinea che le informazioni raccolte vengono utilizzate per migliorare i propri servizi e per sviluppare nuovi prodotti, funzionalità e tecnologie a vantaggio dei propri utenti e del pubblico. Inoltre, come anticipato in apertura, l’azienda può utilizzare le informazioni disponibili al pubblico per contribuire all’addestramento dei suoi modelli di intelligenza artificiale e alla creazione di prodotti e funzionalità come Google Traduttore, Bard e le funzionalità di intelligenza artificiale nel cloud.

L’esame della cronologia delle revisioni della politica rivela una maggiore chiarezza sui servizi che verranno addestrati utilizzando i dati raccolti. Ad esempio, il documento ora specifica che le informazioni possono essere utilizzate per “modelli di intelligenza artificiale” piuttosto che per “modelli linguistici”, dando a Google una maggiore libertà nell’addestramento e costruzione dei propri sistemi basati su IA.

Il problema dei diritti d’autore

Tuttavia la politica aggiornata non chiarisce un punto delicato: come (o se) Google impedirà che materiali protetti da copyright vengano inclusi in questo pool di dati. Sappiamo che molti siti web accessibili al pubblico prevedono politiche che vietano la raccolta di dati o il web scraping per l’addestramento di strumenti di IA; come si combinano queste normative con le nuove politiche di Google rimane al momento una domanda aperta.

Il panorama legale relativo all’utilizzo di dati pubblici per l’addestramento di modelli di IA è complesso e ancora parzialmente indefinito. La dottrina del fair use, che permette l’utilizzo di materiale protetto da copyright per scopi quali l’istruzione e la ricerca, si trova in una zona grigia quando applicata ai software basati su intelligenza artificiale.

Oltre il fair use: le sfide legali

La questione del fair use, insieme alle sfide poste dal GDPR e altre normative internazionali, ha portato a un dibattito legale intenso e, per certi versi, appassionante. Quest’ultimo ha generato diverse cause legali e spinto i legislatori di alcuni Paesi a introdurre normative più severe per regolamentare meglio il modo in cui le aziende di IA raccolgono e utilizzano i loro dati di addestramento; a tal proposito l’Unione Europea sta lavorando proprio in queste settimane a una legge europea che dia delle regole chiare che promuovano un uso dell’intelligenza artificiale trasparente, sicuro e affidabile, ponendo dei divieti e sostenendo alcuni principi fondamentali alla base dei diritti umani.

Ciò solleva interrogativi su come questi dati vengono elaborati per garantire che non contribuiscano a pericolosi malfunzionamenti nei sistemi di IA. Le persone incaricate di esaminare questi vasti bacini di dati di addestramento sono spesso sottoposte a lunghe ore e condizioni di lavoro estreme, una problematica che rende ancora più delicata la questione e che sta iniziando a generare dibattiti anche nel mondo politico.

Al contempo, alcune aziende stanno iniziando a opporsi alla raccolta indiscriminata dei loro dati: Gannett, il più grande editore di giornali degli Stati Uniti, ha intentato una causa contro Google e la sua società madre, Alphabet, sostenendo che i progressi della tecnologia AI hanno aiutato il gigante della ricerca a detenere il monopolio del mercato degli annunci digitali. Ad aggiungersi a ciò, sedici persone anonime hanno portato in tribunale Microsoft e OpenAI: stando alla denuncia, infatti, le due aziende avrebbero raccolto e divulgato le proprie informazioni personali senza un adeguato preavviso o consenso.

Questo scenario complesso si riflette anche sulle piattaforme social di uso comune: Twitter e Reddit, due piattaforme che contengono grandi quantità di informazioni pubbliche, hanno recentemente preso misure drastiche per cercare di impedire ad altre aziende di raccogliere liberamente i loro dati. Le modifiche alle API e le limitazioni imposte alle piattaforme sono state accolte dalle rispettive comunità, in quanto le modifiche anti-scraping hanno influito negativamente sull’esperienza degli utenti dei due social network menzionati poco fa.

Several hundred organizations (maybe more) were scraping Twitter data extremely aggressively, to the point where it was affecting the real user experience.

What should we do to stop that? I’m open to ideas.

— Elon Musk (@elonmusk) June 30, 2023

L’aggiornamento della politica sulla privacy di Google rappresenta un importante passo in avanti nella trasparenza delle pratiche di addestramento dell’IA, tuttavia rimangono numerose sfide da affrontare, sia in termini di rispetto dei diritti d’autore che di protezione dei dati degli utenti. In questo contesto, il dibattito sulla regolamentazione dell’IA e l’uso dei dati per il suo addestramento è destinato a intensificarsi. Seguiremo con attenzione la questione e vi terremo aggiornati sui futuri sviluppi.

Potrebbero interessarti anche: OpenAI disabilita la ricerca con Bing di ChatGPT per problemi legati ai paywall e In che modo l’IA influenza quello che vediamo su Instagram e Facebook?

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione Dyson Clean+Wash Hygiene: la più agile delle lavapavimenti con qualche compromesso

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo