Il rapporto tra intelligenza artificiale e sicurezza informatica sta diventando sempre più stretto, e non solo sul fronte degli attacchi. Se da un lato i modelli AI vengono sfruttati per generare malware, phishing più convincente e tecniche di intrusione sempre più sofisticate, dall’altro possono rivelarsi strumenti preziosi anche per chi deve difendere software e infrastrutture e la collaborazione annunciata da Mozilla con Anthropic ne è una dimostrazione concreta.

L’azienda dietro Firefox ha iniziato a lavorare con il Frontier Red Team di Anthropic per identificare e correggere vulnerabilità di sicurezza potenzialmente pericolose nel browser. E i primi risultati sono notevoli: in sole due settimane, Claude ha individuato oltre 100 bug, di cui 14 classificati come ad alta severità. Scendiamo nel dettaglio.

Indice:

Com’è nata la collaborazione tra Mozilla e Anthropic

Secondo quanto comunicato da Mozilla, il team di Anthropic li ha contattati alcune settimane fa presentando i risultati di un nuovo metodo di ricerca bug assistito dall’intelligenza artificiale. L’approccio sembra funzionare davvero, e potrebbe tradursi in un’esperienza di navigazione più sicura per tutti gli utenti di Firefox.

Il team di Anthropic si è concentrato sul motore JavaScript di Firefox, una scelta non casuale. Il browser offre un codebase open source ampiamente utilizzato e già sottoposto a controlli approfonditi nel corso degli anni da parte della community e di ricercatori di sicurezza.

I numeri della scoperte di Claude

Il sistema basato su Claude ha individuato diverse falle di sicurezza nel motore JS, producendo anche casi di test minimali che hanno permesso agli sviluppatori di Firefox di verificare e riprodurre rapidamente i problemi.

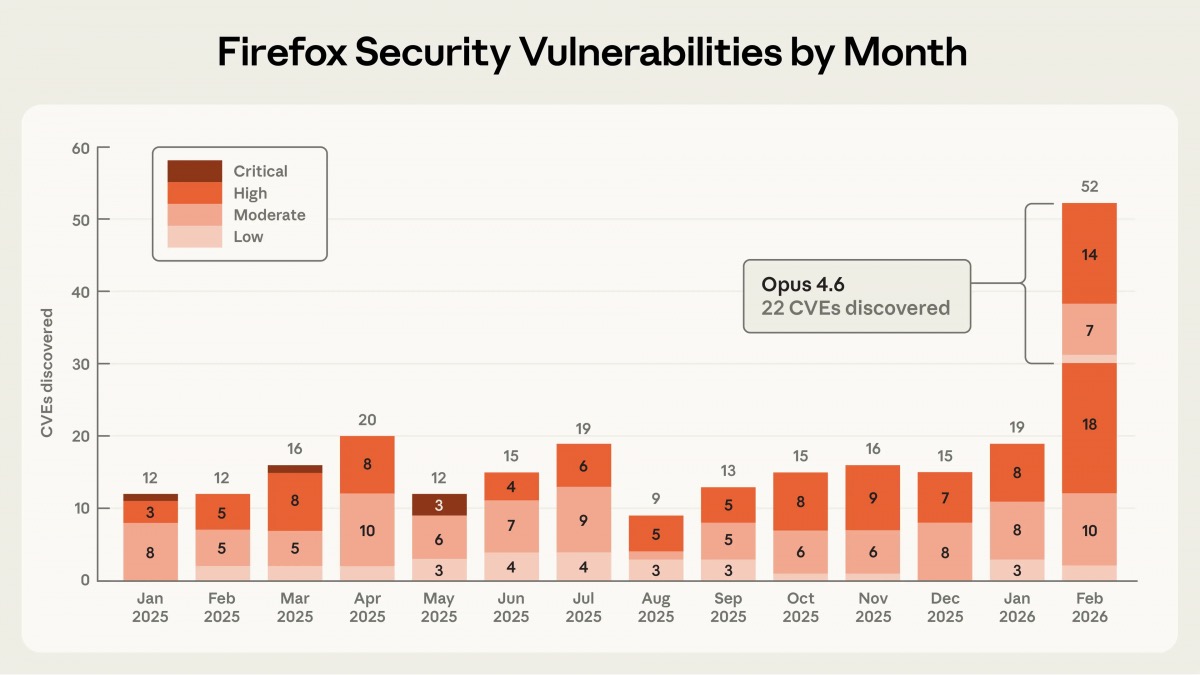

I numeri sono impressionanti: gli sviluppatori hanno confermato 14 bug di sicurezza ad alta severità, che hanno portato all’assegnazione di 22 identificativi CVE separati. Mozilla ha precisato che tutte queste vulnerabilità sono già state corrette nella versione più recente di Firefox, la 148.0. Il processo ha inoltre portato alla luce 90 bug aggiuntivi a priorità più bassa, anch’essi già risolti.

Un approccio diverso dagli altri

Mozilla ha sottolineato come l’approccio di Anthropic alla segnalazione dei bug si distingua nettamente da altri tentativi basati sull’intelligenza artificiale. Il problema, va detto, esiste tanto che alcuni importanti progetti open source, tra cui curl, sono stati costretti a scoraggiare o addirittura vietare i contributi generati dall’AI dopo essere stati inondati da segnalazioni di bassa qualità.

Il fenomeno è legato in parte ai cosiddetti programmi di bug bounty: alcuni utenti hanno iniziato a usare modelli AI per generare report di vulnerabilità senza verificarne l’accuratezza, sperando di ottenere ricompense con il minimo sforzo. Il risultato, in classico stile AI, è stato un flusso di segnalazioni “allucinate“, ovvero bug inesistenti o descritti in modo errato, che ha fatto perdere tempo prezioso ai sistemisti dei progetti.

Il lavoro di Anthropic con Mozilla dimostra però che, con il giusto approccio e una supervisione adeguata, l’intelligenza artificiale può effettivamente accelerare sia gli attacchi che le difese nel campo della sicurezza informatica.

Un aspetto particolarmente interessante riguarda il tipo di vulnerabilità scoperte. Molte delle falle individuate attraverso la tecnica di Anthropic sono del tipo che normalmente viene identificato tramite fuzzing, un metodo di test automatizzato che invia input imprevisti al software per provocare crash e comportamenti anomali.

Tuttavia, Mozilla ha spiegato che il modello AI ha identificato anche diverse classi di bug logici che le tecniche di fuzzing tradizionali spesso non riescono a intercettare. L’azienda spiega che si tratta di errori più sottili, legati alla logica del codice piuttosto che a classici crash, e che possono essere molto pericolosi dal punto di vista della sicurezza.

Questo dunque ci suggerisce che l’AI può andare oltre la semplice automazione dei test esistenti, trovando problemi che altrimenti resterebbero nascosti anche dopo anni di analisi convenzionali.

I prossimi passi di Mozilla

Alla luce dei risultati ottenuti, Mozilla ha comunicato di voler integrare il nuovo metodo assistito dall’AI nel proprio flusso di lavoro di sviluppo e sicurezza. L’organizzazione si aspetta che i modelli Claude di Anthropic e altri sistemi AI avanzati possano contribuire a scoprire ulteriori problemi in futuro.

Se l’approccio si dimostrerà scalabile, potrebbe aiutare a identificare un gran numero di bug finora quasi introvabili anche in altri progetti open source popolari, dove il fuzzing e le altre tecniche tradizionali hanno raggiunto i propri limiti. Insomma, per la sicurezza del software che usiamo ogni giorno, sarebbe una buona notizia.

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione Amazfit Active 3 Premium: elegante e curato, con un prezzo democratico

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo