Deepfake: se non ne avete sentito parlare nelle scorse settimane probabilmente non vivete in Italia, oppure siete stati in vacanza. In Italia il primo deepfake di alto livello l’hanno realizzato quelli di Striscia la Notizia, il programma di Antonio Ricci, salito alla ribalta per aver utilizzato questa pericolosa quanto affascinante tecnica di contraffazione in un video. Al suo interno viene emulato in tutto e per tutto il comportamento, la mimica facciale e il parlato di Matteo Renzi.

Indice:

Il video deepfake, disponibile alla visione qui, è stato realizzato da Striscia la Notizia utilizzando un software della Nasa, ma chiunque può scaricare il programma e seguire dei tutorial per realizzare un video fatto in casa. Certo, ci vogliono centinaia di ore di lavoro, competenze di programmazione e tanto, tanto materiale audiovisivo per arrivare ad un risultato soddisfacente, ma è sicuramente possibile farlo.

Segui TuttoTech.net su Google Discover

Cosa è un deepfake

Un deepfake è un contenuto video, fotografico o audio modificato con l’aiuto dell’intelligenza artificiale. Perché realizzare un deepfake? Per lo stesso motivo per cui al giorno d’oggi ci sono fake news e bufale: notorietà, spostamento dell’opinione pubblica, controllo delle menti. Non stiamo parlando di una realtà distopica orwelliana, parliamo di ciò che succede quotidianamente: dalle elezioni americane sapientemente plasmate dai russi ai risultati della Brexit, al giorno d’oggi contenuti audio-visivi credibili sono un’arma potentissima, nelle mani sbagliate.

Un po’ abbiamo perso la capacità analitica di confrontarci con i contenuti e le informazioni che ci bombardano, letteralmente, durante ogni momento della nostra giornata. In parte, non siamo attrezzati con gli strumenti necessari per riconoscere i deepfake: quelli migliori possono ingannare così sapientemente i nostri sensi da indurci a credere che il contenuto sia reale.

Deepfake e l’eterna lotta contro le notizie false

Non deve stupire quindi se il Wall Street Journal ha deciso di mettere in piedi nel 2018 un intero team di esperti di machine learning, capitanati da Francesco Marconi, 33 anni e origini italo-portoghesi. Lui ed il suo team combattono una guerra quotidiana per smascherare le fake news e i deepfake, insegnando in contemporanea ai reporter a riconoscere i contenuti autentici da quelli manipolati. Anche se, a detta sua, è un po’ come giocare al gatto con il topo: “Ogni volta che mettiamo a punto un nuovo sistema di verifica dei contenuti, ecco che arriva un aggiornamento che lo aggira”.

Guardando il video di Striscia la Notizia, ma anche altri notevoli esempi disponibili in rete realizzati da veri e propri artisti del deepfake come Sham00K, salta subito all’occhio la pericolosità di una tecnologia che unisce la volontà di trasmettere informazioni false in un contenuto che di solito siamo portati a credere, come è il medium video. In realtà la minaccia per i contenuti deepfake arriva da tutti i fronti.

“Oggi non si fa che parlare di deepfake video, ma non dobbiamo dimenticare che una minaccia altrettanto allarmante arriva dagli audio modificati con l’aiuto dell’A.I”, replica Marconi intervistato da Giornalettismo.com. Proprio lo scorso anno il suo giornale, il Wall Street Journal, ha riportato il caso di un amministratore delegato di una azienda energetica inglese: un gruppo di criminali è riuscito ad estorcergli 220 mila euro imitando la voce di un suo superiore attraverso l’utilizzo di un software.

Come riconoscere un deepfake

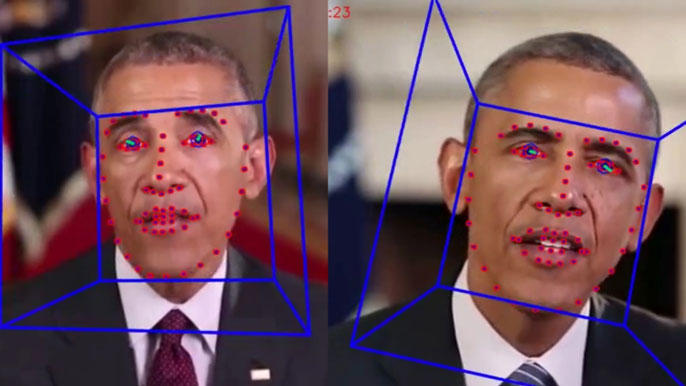

Lo dicevamo poche righe più sopra: è difficile riconoscere un deepfake se non si posseggono gli strumenti giusti. Esistono però delle tecniche e algoritmi che analizzano il video alla ricerca di elementi anomali che tradiscano la loro natura di deepfake.

Ad esempio un algoritmo della State University of New York consente di distinguere un video originale da uno contraffatto analizzando con precisione la posizione degli occhi nel video, tenendo traccia di ogni battito di ciglia. Normalmente gli esseri umano chiudono gli occhi per una frazione di secondo ogni 2-10 secondi: in un video contraffatto spesso ciò non avviene.

Un’altra tecnica messa a punto dai ricercatori del MIT di Boston consiste nel nell’individuare le pulsazioni umane, evidenziando mutamenti nel colore della pelle che ad occhio nudo non sarebbero visibili. Analizzando pixel per pixel l’intero video, ed amplificando il colore e la frequenza delle variazioni date dal battito, si riescono a percepire movimenti e cambiamenti di colore non normalmente visibili in soggetti umani, che non sono però presenti nei video deepfake.

Ultima tecnica, che è alla portata di tutti, è quella di analizzare il filmato al rallentatore, fotogramma per fotogramma. Ingrandendo la scena video potremo notare, andando avanti nella riproduzione, artefatti, scintillii o sfocature in punti critici come gli angoli della bocca, il contorno del viso e degli occhi o altri elementi che smascherano il filmato come deepfake.

I nostri contenuti da non perdere:

- 🔝 Importante: Intel Core Ultra 5 250K Plus vs AMD Ryzen 7 9850X3D: quale scegliere e perché

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo