Ci si interroga spesso sulla capacità dell’intelligenza artificiale di emulare il ragionamento umano e replicare le caratteristiche specifiche delle persone. Si dice che l’AI non ha emozioni e sentimenti e che non sia in grado di apprendere davvero dall’esperienza, limitandosi a elaborare dati senza mai costruire una memoria persistente e significativa del lavoro svolto. Anthropic sembra voler sfidare almeno in parte questa convinzione.

Segui TuttoTech.net su Google Discover

Il dreaming di Anthropic

Quando ad aprile Anthropic ha presentato Claude Managed Agents, il proprio sistema per la gestione di agenti di intelligenza artificiale all’interno del cloud, aveva anticipato la volontà di rendere questi strumenti più utili e concreti per chi li utilizza, riducendo la complessità tecnica necessaria per metterli in funzione.

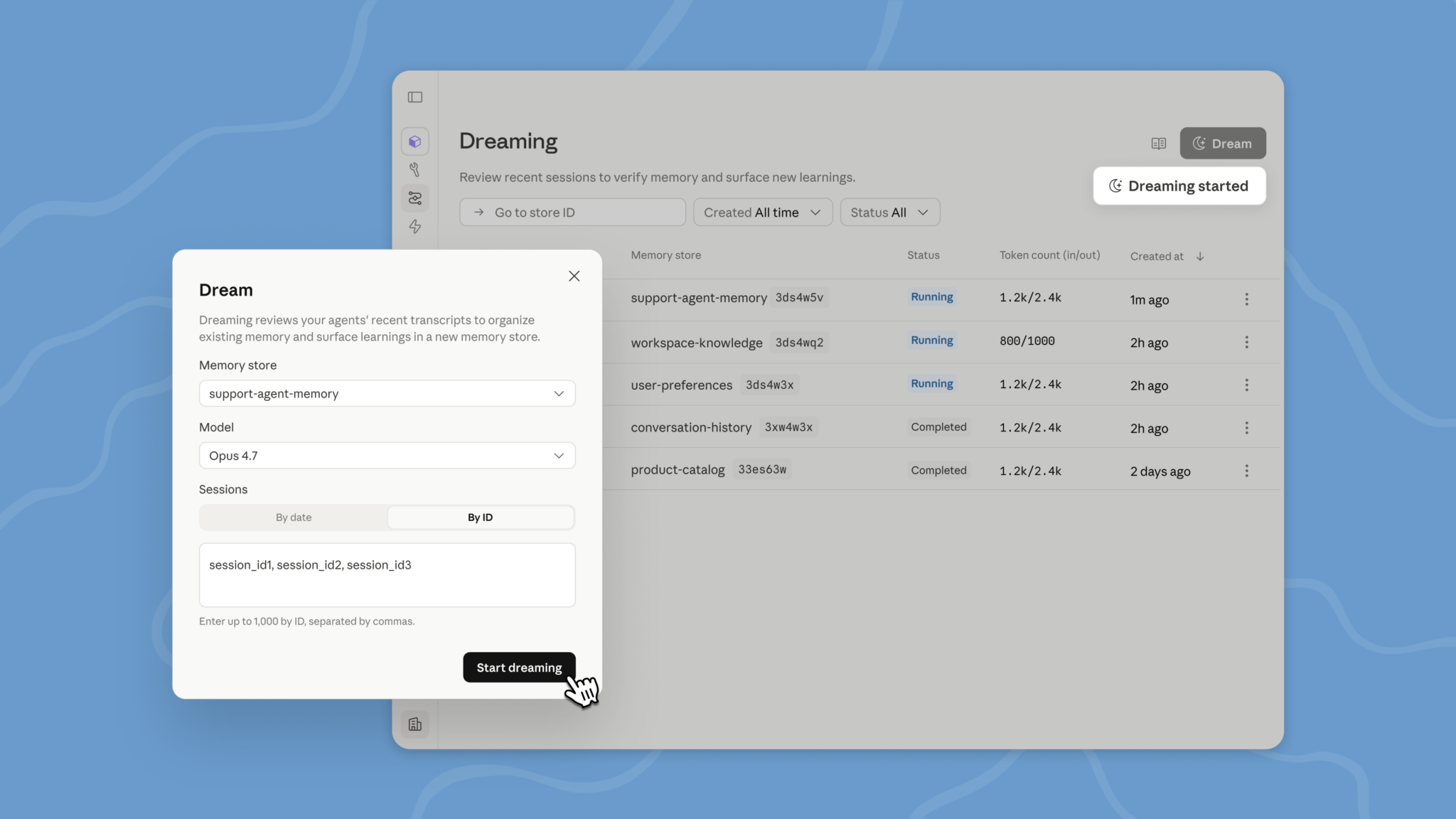

Ora, in occasione della conferenza Code with Claude dedicata agli sviluppatori, quella direzione compie un ulteriore passo in avanti con l’introduzione di una funzionalità dal nome suggestivo: il dreaming, ossia la capacità degli agenti di “sognare”.

Ma di cosa stiamo parlando? Il termine è volutamente evocativo, ma il meccanismo sottostante è tecnico. L’idea è che, una volta terminato il lavoro degli agenti, sia possibile attivare uno stato di dreaming in cui il sistema passa in rassegna tutto ciò che gli agenti hanno fatto dall’ultima sessione, costruendo un riepilogo strutturato di quanto è accaduto. In modo analogo a come il cervello umano aggiorna la propria rete di memorie durante il sonno, Claude nei Managed Agents esegue ora un processo schedulato che gli consente di elaborare e rivedere il lavoro recente, identificare pattern e conservare le osservazioni aggiornate nella memoria.

Il problema che questa funzionalità intende risolvere è legato al funzionamento dei modelli linguistici di grandi dimensioni e con il quale chi usa spesso l’AI ha iniziato a familiarizzare. Le finestre di contesto sono limitate e le informazioni rilevanti rischiano di andare perse nel corso di progetti lunghi e strutturati. In questo stato, Claude individua pattern che un singolo agente non sarebbe in grado di riconoscere da solo, tra cui errori ricorrenti, flussi di lavoro su cui gli agenti convergono e preferenze condivise tra i membri di un team. Riorganizza inoltre la memoria accumulata, eliminando le informazioni superflue e mantenendo solo quelle effettivamente utili per il lavoro futuro.

Gli sviluppatori possono scegliere di lasciare che il dreaming aggiorni la memoria in modo automatico, oppure di revisionare le modifiche prima che vengano scritte definitivamente. Anthropic precisa che la funzionalità è disponibile in anteprima di ricerca e che potrebbero essere introdotte modifiche sostanziali durante questo periodo. Proprio per questo chi vuole utilizzarla è invitato a non impiegarla su flussi di lavoro critici o sensibili.

L’efficacia del dreaming e le nuove funzionalità di Anthropic

I risultati nei test preliminari sembrano dare buoni risultati. Secondo Anthropic, team di alto profilo tra cui Netflix e Wisedocs stanno già mettendo alla prova questi strumenti. Il team di Netflix li usa per analizzare log di build su larga scala, mentre Wisedocs (che si occupa di revisione e gestione documentale) dichiara che le proprie revisioni documentali risultano ora più rapide del 50%. Harvey, che opera in ambito legale, ha utilizzato il dreaming per aiutare i propri agenti a memorizzare soluzioni specifiche legate ai tipi di file e ai pattern degli strumenti, con tassi di completamento cresciuti di circa sei volte nei test.

Insieme al dreaming, Anthropic ha reso disponibili in beta pubblica altre due funzionalità per i Managed Agents. La prima riguarda gli outcomes, ovvero la possibilità per gli sviluppatori di definire criteri precisi che descrivono come appare un risultato soddisfacente. Un agente valutatore separato esamina quindi l’output prodotto e, quando questo non raggiunge lo standard atteso, richiede automaticamente una revisione. Nei test interni questa funzionalità ha migliorato il tasso di successo fino al 10% rispetto a un approccio basato su prompt standard, con i guadagni più consistenti sui compiti più complessi.

La seconda novità è l’orchestrazione multi-agente. Un agente principale può suddividere compiti complessi tra agenti specializzati, ciascuno dotato di un proprio modello, prompt e set di strumenti. Gli agenti possono lavorare in parallelo su un filesystem condiviso, contribuire al contesto dell’agente principale e restare tracciabili attraverso la Claude Console.

Memory e dreaming formano insieme, nelle parole di Anthropic, un sistema di memoria robusto per agenti capaci di migliorarsi in autonomia. La memoria consente a ogni agente di catturare ciò che apprende mentre lavora, il dreaming raffina quella memoria tra una sessione e l’altra e consolida gli apprendimenti condivisi tra più agenti.

Una realtà che ha poco a che fare con la visione onirica degli esseri umani, ma che punta a rendere gli agenti IA sempre meno dipendenti dall’intervento umano nelle attività complesse e prolungate. Sicuramente un vantaggio, ma anche qualcosa che potrebbe favorire qualche incubo. Tanto per rimanere in tema.

I nostri contenuti da non perdere:

- 🔝 Importante: Amazfit è pronta a lanciare Bip Max, ecco le indiscrezioni più interessanti

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo