Il lavoro di Apple nel campo dell’intelligenza artificiale continua a evolversi in maniera piuttosto evidente e, come spesso accade quando si parla dei laboratori di Cupertino, emergono soluzioni che non si limitano a inseguire i trend del momento, ma provano a ridefinire alcuni passaggi chiave dell’esperienza utente e dello sviluppo software. Gli ultimi studi pubblicati dall’azienda infatti, ci offrono uno sguardo interessante su due ambiti ben distinti ma sempre più centrali: la prototipazione delle interfacce utente e la valutazione della sicurezza delle immagini.

Indice:

4 x Xiaomi Smart Tag

Smart Tracker, compatibile con Apple Find My e Google Android Find Hub

SQUIRE è un sistema per avere più controllo nella creazione di interfacce con l’IA

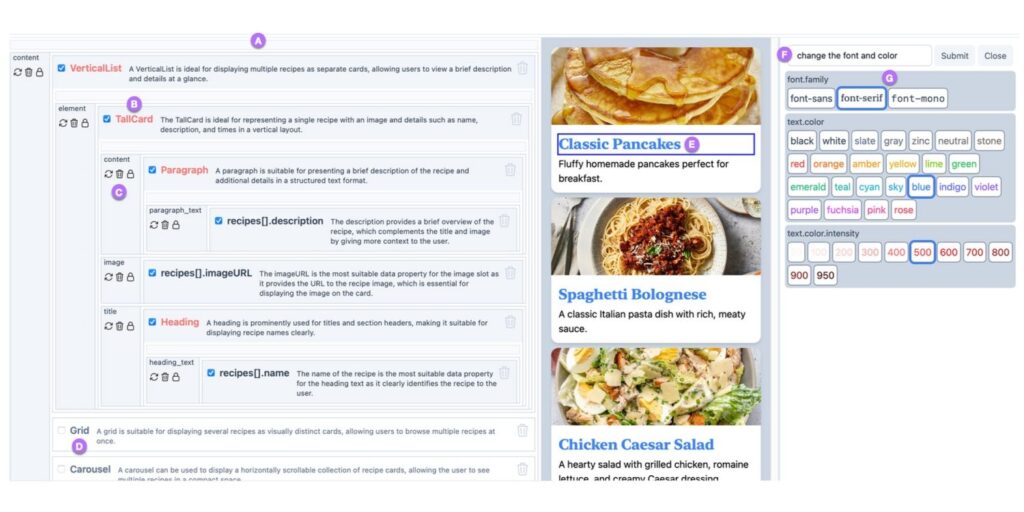

Partiamo da SQUIRE, un sistema sperimentale sviluppato da Apple che affronta uno dei limiti più evidenti degli attuali strumenti basati su modelli linguistici, ovvero l’imprevedibilità.

Come alcuni di voi potrebbero aver notato utilizzando soluzioni di vibe coding (cioè la generazione di codice tramite prompt in linguaggio naturale), il problema principale è spesso duplice: da una parte l’ambiguità del linguaggio umano, dall’altra la tendenza dei modelli a produrre risultati non sempre coerenti con l’intento iniziale, ed è proprio qui che SQUIRE prova a fare la differenza.

Il sistema introduce un approccio decisamente più strutturato, invece di generare il codice finale, costruisce una rappresentazione intermedia dell’interfaccia, chiamata SquireIR, organizzata come un albero di componenti. In altre parole, l’interfaccia viene scomposta in elementi modulari, ciascuno dei quali può essere modificato, sostituito o completato in modo indipendente.

Gli sviluppatori iniziano fornendo un prompt (come avviene già oggi con gli LLM), ma a quel punto il processo cambia radicalmente: ogni richiesta viene collegata a una specifica porzione dell’interfaccia, evitando modifiche indesiderate sul progetto. Il sistema, basato su GPT-4o, suggerisce quindi diverse alternative per colmare lacune individuate, permettendo di confrontare rapidamente più soluzioni grazie a un’anteprima aggiornata in tempo reale.

Il risultato, almeno secondo lo studio condotto da Apple su 11 sviluppatori frontend, è un’esperienza molto più controllabile e prevedibile; gli utenti si sono detti più inclini a sperimentare, proprio perché ogni modifica può essere facilmente visualizzata, corretta o annullata senza compromettere il resto del lavoro. Un cambio di paradigma non da poco, soprattutto se pensiamo a quanto oggi il ciclo di tentativi ed errori sia ancora centrale nello sviluppo assistito dall’IA.

Non manca poi l’integrazione con le tecnologie web più comuni (HTML, CSS, JavaScript e Web Components), a conferma di un approccio che punta sì all’innovazione, ma senza rompere la compatibilità con gli strumenti già utilizzati quotidianamente.

SQUIRE, almeno per il momento, resta un progetto sperimentale e non è disponibile al pubblico. Tuttavia, non è difficile immaginare una sua futura integrazione in Xcode, che già oggi, soprattutto nelle versioni più recenti come la 26.3, sta iniziando ad aprirsi sempre di più agli strumenti di programmazione agentica e ai modelli linguistici avanzati, inclusi quelli di OpenAI e Anthropic.

In questo senso, SQUIRE potrebbe rappresentare un tassello fondamentale per rendere la generazione di interfacce non solo più veloce, ma anche più affidabile e controllabile, riducendo uno dei principali ostacoli all’adozione su larga scala di queste tecnologie.

Segui APPLE Italia su Telegram, ricevi news e offerte per primo

Apple lavora anche sulla sicurezza delle immagini con SafetyPairs

Parallelamente, Apple sta esplorando un secondo filone altrettanto interessante: la valutazione della sicurezza dei contenuti visivi generati o analizzati tramite IA.

Con lo studio SafetyPairs, i ricercatori introducono un framework basato su coppie di immagini controfattuali, ovvero quasi identiche ma con una differenza chiave che ne cambia la classificazione (sicura o non sicura); per esempio, due immagini simili, dove una include elementi problematici come violenza, gesti offensivi o contenuti sensibili, e l’altra no.

L’obbiettivo è duplice, da un lato individuare con maggiore precisione i punti deboli dei modelli di visione artificiale, dall’altro migliorare i dataset utilizzati per addestrarli. Il progetto ha già prodotto oltre 1.500 coppie di immagini, utilizzate per testare e affinare le capacità di valutazione dei sistemi IA.

Si tratta, evidentemente, di un ambito cruciale, soprattutto considerando funzionalità già disponibili come Image Playground, che permettono agli utenti di generare immagini direttamente sui dispositivi; migliorare i sistemi di controllo significa quindi rendere queste tecnologie più sicure e affidabili anche in contesti reali.

Come spesso accade con questo tipo di ricerche, non è ancora chiaro quali di queste tecnologie arriveranno effettivamente nei prodotti finali; tuttavia, il fatto che Apple stia investendo contemporaneamente su produttività e sicurezza suggerisce una direzione ben precisa.

Con la WWDC 2026 ormai all’orizzonte (l’appuntamento è fissato per l’8 giugno), non è da escludere che almeno parte di questi concetti possa iniziare a concretizzarsi già nei prossimi aggiornamenti di iOS, macOS o degli strumenti di sviluppo.

- Apre nei Paesi Bassi il più grande museo Apple d’Europa

- Apple ha rilasciato iOS 26.4.1 e iPadOS 26.4.1 su iPhone e iPad compatibili

- Samsung e Apple siglano un accordo in esclusiva di 3 anni per i display di iPhone Fold

- Apple si rivolge di nuovo alla Corte Suprema nella battaglia legale contro Epic Games

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione SwitchBot AI Hub, l'hub definitivo per la smart home

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo