In occasione dell’annuale NVIDIA GTC, conferenza dedicata al mondo dell’intelligenza artificiale, NVIDIA ha annunciato una serie di novità in arrivo per il settore IA. Le soluzioni anticipate da NVIDIA non sono (almeno per il momento) destinate al mercato consumer ma rappresentano ugualmente un’interessante anteprima di quello che l’azienda potrebbe avere in cantiere per il suo futuro nel corso dei prossimi anni.

L’intelligenza artificiale ricoprirà un ruolo di primo piano per le attività future di NVIDIA e le novità anticipate in occasione della GTC rappresentano una preview importantissima per quello che l’azienda potrebbe lanciare in futuro. Vediamo i dettagli completi in merito alle anticipazioni dell’azienda arrivate nel corso della giornata di oggi.

NVIDIA punta sull’intelligenza artificiale: debuttano la nuova architettura Hopper e la GPU H100

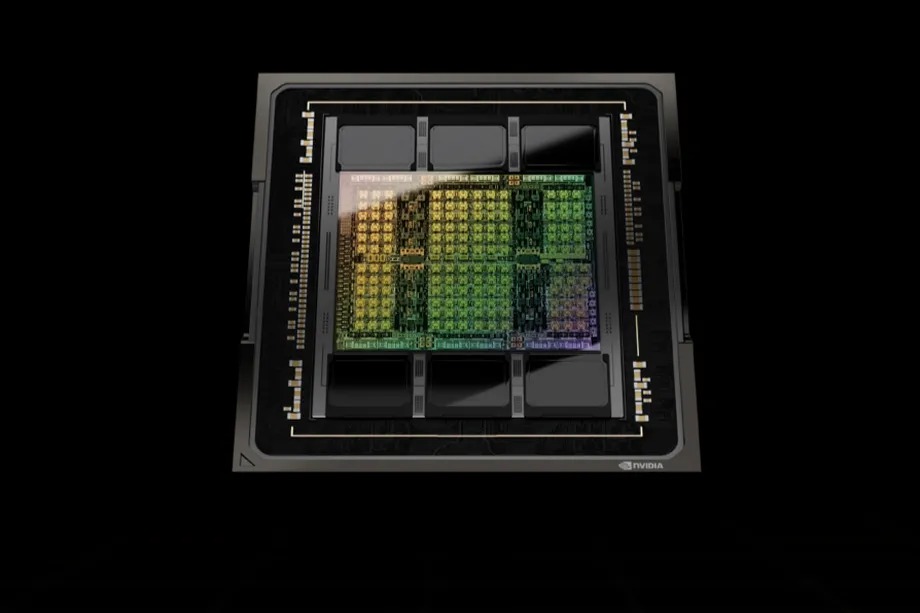

Tra le novità anticipate da NVIDIA in occasione dell’annuale conferenza GTC c’è l’inedita architettura Hopper. Si tratta di una soluzione pensata per i data center del (prossimo) futuro che promette prestazioni elevate per quanto riguarda la capacità di calcolo. Quest’architettura consentirà di accelerare in misura significativa la capacità di apprendimento dei sistemi di machine learning Transformer.

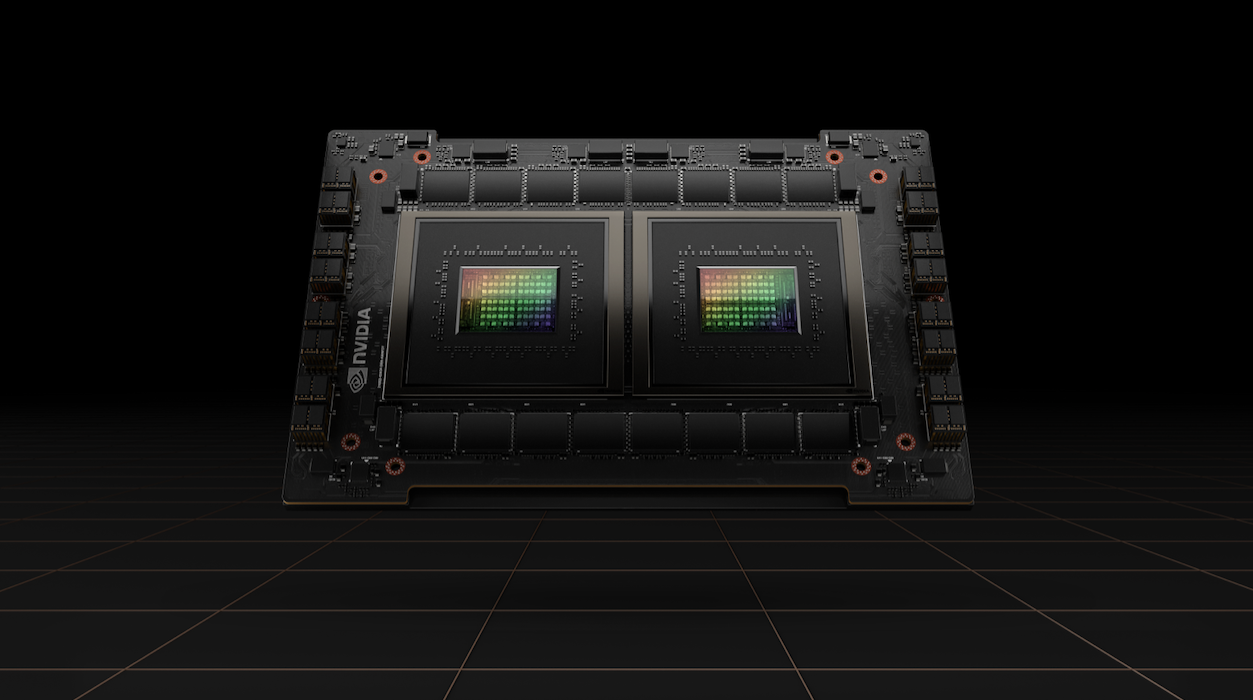

A garantire quest’accelerazione ci sarà anche un’altra novità introdotta oggi da NVIDIA. Si tratta della GPU H100, realizzata utilizzando la nuova architettura svelata da NVIDIA. Grazie a questa GPU, infatti, sarà possibile ottenere un incremento fino a 6 volte della velocità di apprendimento delle soluzioni Transformer nel confronto con quanto accade con le soluzioni di precedente generazione.

Da notare che ricorrendo alla quarta generazione di NVIDIA NVlink sarà possibile connettere fino ad un massimo di 256 GPU H100 arrivando ad ottenere una larghezza di banda circa 9 volte superiore rispetto a quanto registrato con la precedente generazione. La nuova GPU H10 può contare su 80 miliardi di transistor ed è la prima a supportare lo standard PCIe Gen5 e ad utilizzare le memorie HBM3 potendo contare su di una banda di 3 TB/s. Rispetto alla A100, la soluzione di precedente generazione di NVIDIA, la H100 è dalle 3 alle 8 volte più veloce, in base al contesto di utilizzo.

Una nuova CPU per data center e un super computer in arrivo

Tra le novità annunciate dall’azienda, inoltre, c’è anche la nuova CPU per data center, denominata Grace CPU Superchip, formata dalla connessione di due CPU con un sistema di bassa latenza NVLink-C2C. Questo chip è pensato per gestire soluzioni avanzate HPC e AI affiancando la GPU con architettura Hopper. Questa nuova soluzione proposta da NVIDIA può contare su 144 core ARM e su di una banda di memoria da 1 TB/s.

In arrivo c’è anche un super computer. NVIDIA, infatti, ha anticipato, infatti, il lancio di Eos, un nuovo supercomputer basato sull’IA che in futuro è destinato a diventare “il più veloce al mondo” secondo le anticipazioni dell’azienda. Il nuovo progetto verrà realizzato sfruttando l’architettura Hopper e integrerà 4.600 GPU H100 arrivando ad offrire fino a 18.4 exaflop di “performance IA”. Almeno inizialmente, Eos verrà utilizzato da NVIDIA solo internamente. Il progetto sarà pronto nei prossimi mesi.

Leggi anche: L’intelligenza artificiale può aiutare a usare la fusione nucleare come fonte di energia

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione Amazfit Active 3 Premium: elegante e curato, con un prezzo democratico

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo