OpenAI ha annunciato ChatGPT Salute, una nuova sezione dedicata all’interno di ChatGPT pensata esclusivamente per conversazioni su salute e benessere, con la possibilità di collegare cartelle cliniche elettroniche e app di wellness come Apple Salute, MyFitnessPal e altri servizi partner. L’obiettivo dichiarato è offrire risposte più mirate, basate sul contesto personale dell’utente, aiutando a interpretare esami, preparare visite e comprendere meglio il proprio stato di salute nel tempo.

Secondo i dati condivisi da OpenAI, ogni settimana centinaia di milioni di persone pongono a ChatGPT domande su salute e benessere, con una stima di oltre 200–230 milioni di utenti che usano già il chatbot come primo filtro informativo in campo medico. ChatGPT Salute nasce proprio da questo uso spontaneo: invece di limitarsi a rispondere a quesiti generici, ora l’IA può attingere a dati reali dell’utente per fornire spiegazioni e approfondimenti più aderenti alla situazione individuale. Le integrazioni con cartelle cliniche e alcune app sono per ora disponibili solo negli USA, mentre per usare Apple Salute è necessario iOS, a conferma di un roll-out ancora limitato ma destinato a crescere nelle prossime settimane, con accesso inizialmente su lista d’attesa. In Italia e in UE al momento non è possibile utilizzarla.

Indice:

Come funziona: uno spazio separato, tra cartelle cliniche e app

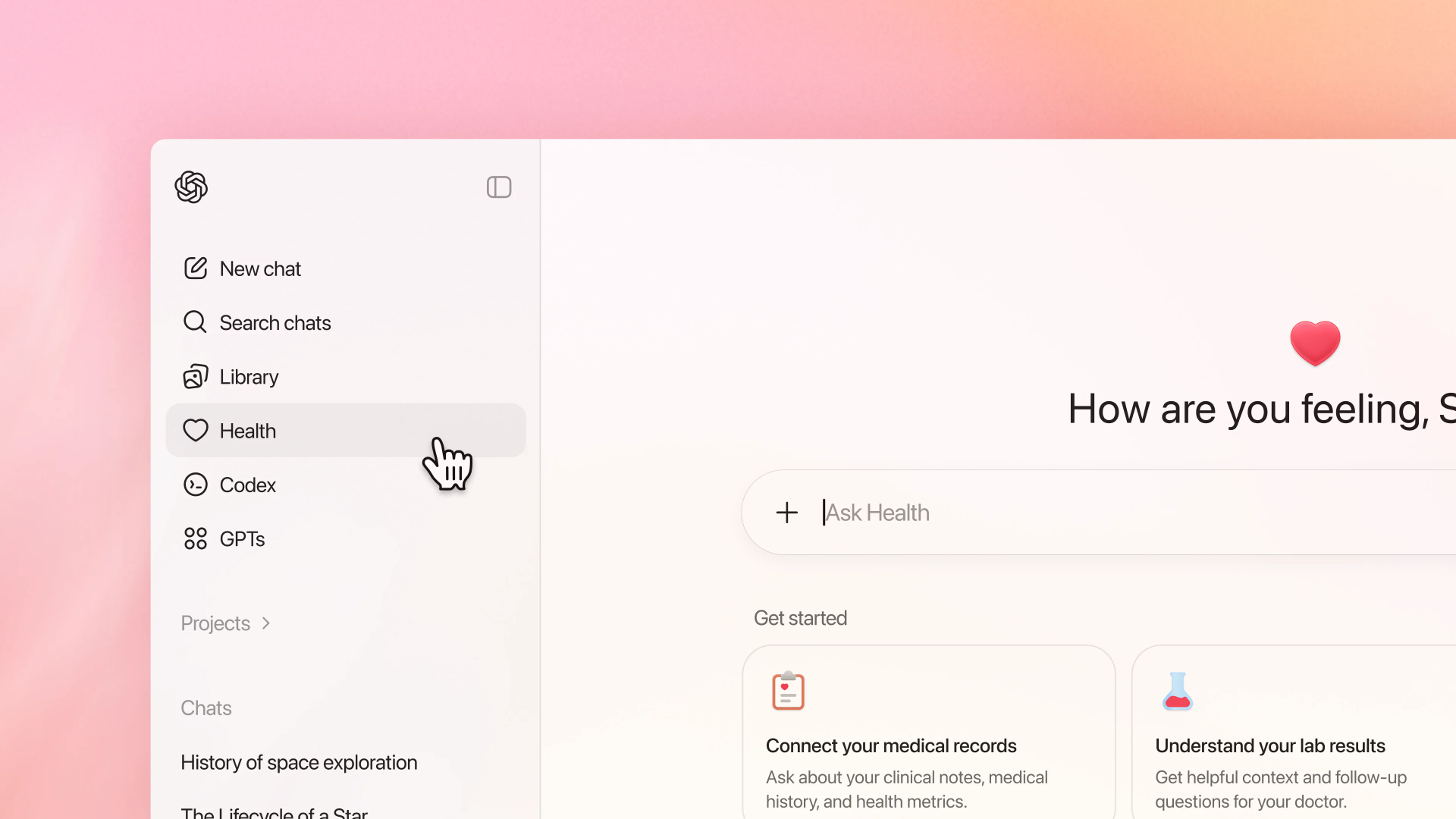

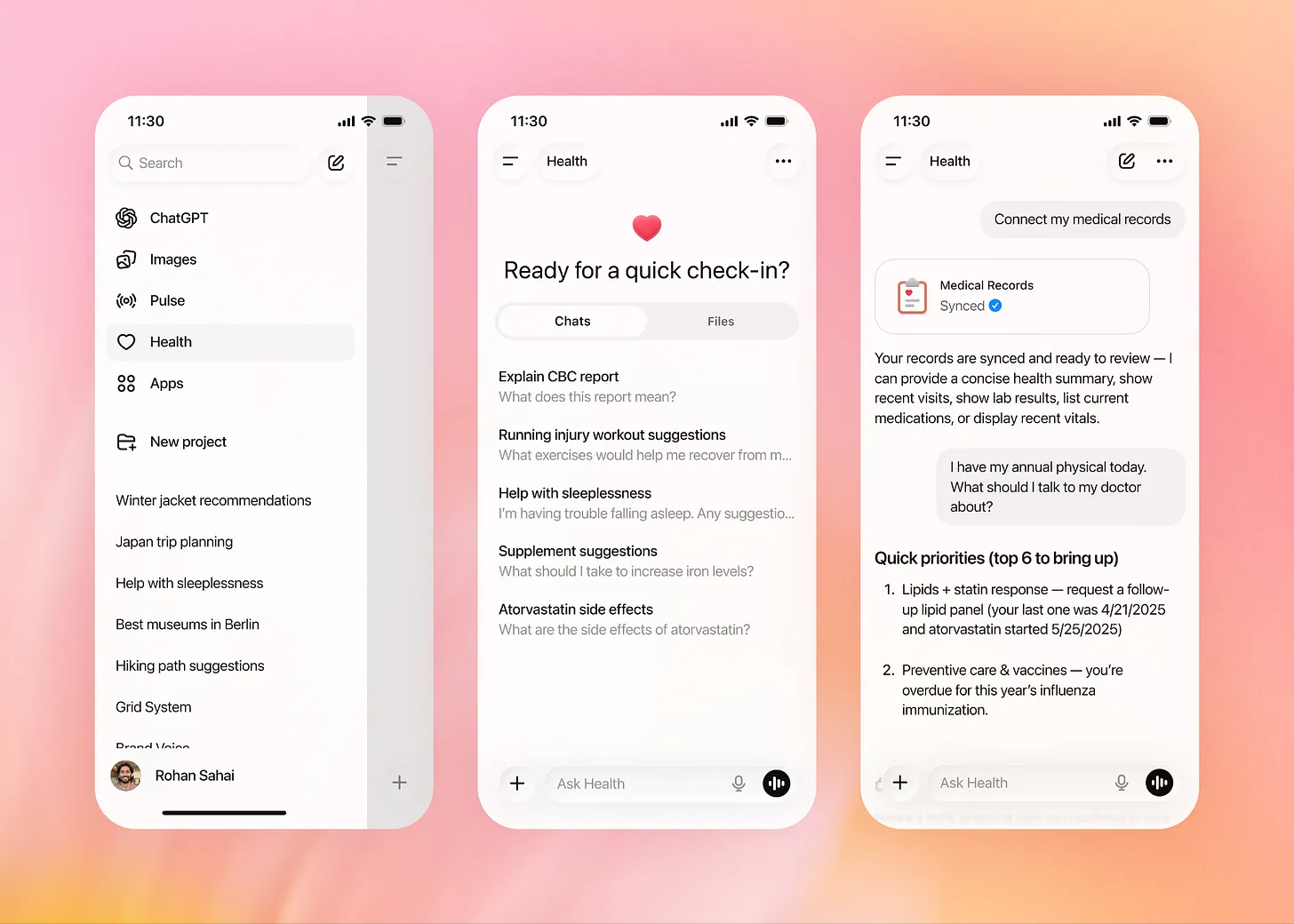

ChatGPT Salute non è un semplice “tema” ma un vero spazio separato all’interno dell’interfaccia del chatbot, con cronologia e memorie dedicate, in cui conversazioni, file e app collegate vengono tenuti isolati rispetto alle chat tradizionali. Ciò significa che il contesto sanitario resta confinato in questa sezione, mentre le altre conversazioni non possono accedere a cartelle cliniche, documenti o memorie create in Salute.

L’utente può:

- collegare le cartelle cliniche elettroniche (attraverso partner come b.well, al momento limitati agli Stati Uniti e a maggiorenni) per avere dentro ChatGPT risultati di laboratorio, riepiloghi visite e storia clinica;

- integrare app come Apple Salute, Function, MyFitnessPal, Weight Watchers, AllTrails, Instacart o Peloton per unire esami, attività fisica, alimentazione e abitudini quotidiane in un unico quadro conversazionale;

- caricare manualmente PDF, referti, fotografie di esami o note, e chiedere al modello di spiegarne il contenuto in linguaggio accessibile, di sintetizzare le informazioni o di suggerire domande da fare al medico.

Segui l'Intelligenza Artificiale su Telegram, ricevi news e offerte per primo

Privacy, crittografia e limiti dichiarati: abbastanza per stare tranquilli?

Uno dei punti più delicati è ovviamente la gestione dei dati sanitari, per definizione tra le informazioni più sensibili che si possano immaginare. OpenAI sottolinea che ChatGPT Salute opera in uno “spazio dedicato” con tutele aggiuntive: conversazioni e file sono crittografati in transito e a riposo, con sistemi di crittografia specifici per la salute e meccanismi di isolamento che impediscono a queste informazioni di fluire nelle chat standard.

La società ribadisce due promesse chiave:

- le conversazioni all’interno di ChatGPT Salute non vengono utilizzate per addestrare i modelli di base;

- l’accesso di app e servizi terzi ai dati sanitari avviene solo previo consenso esplicito, con requisiti di privacy stringenti e raccolta limitata ai dati minimi necessari, sempre revocabile dall’utente in qualsiasi momento.

Esistono anche controlli aggiuntivi lato utente, come la possibilità di abilitare l’autenticazione a più fattori sull’account (MFA) e di visualizzare o cancellare in qualsiasi momento le memorie di Salute dalle impostazioni di personalizzazione. Tuttavia, il quadro non è privo di criticità: diversi osservatori ricordano che, nonostante le tutele, affidare a un’azienda privata una copia strutturata della propria storia clinica comporta comunque un rischio sistemico, tanto più alla luce delle cause legali che accusano ChatGPT di aver contribuito a casi di psicosi o suicidio.

Un’IA “allenata” dai medici (ma che non è un medico)

Per cercare di rendere le risposte più sicure, OpenAI dichiara di aver sviluppato ChatGPT Salute in stretta collaborazione con oltre 260 medici di 60 Paesi, che hanno fornito feedback su centinaia di migliaia di risposte in decine di aree di analisi. Questa collaborazione ha contribuito sia a definire cosa renda utile una risposta sanitaria, sia a evidenziare cosa possa risultare potenzialmente pericoloso, con particolare attenzione alla necessità di indirizzare l’utente verso un medico quando la situazione lo richiede.

Il modello che alimenta ChatGPT Salute è stato valutato attraverso HealthBench, un framework di benchmark sviluppato per misurare il comportamento delle IA in scenari clinici realistici. HealthBench non si limita a quiz in stile esame, ma usa 5.000 conversazioni multi-turno valutate con rubriche scritte da medici, con oltre 48.000 criteri che considerano accuratezza, chiarezza, correttezza dell’escalation delle cure e capacità di gestire l’incertezza.

Nonostante questa architettura “guidata dai medici”, OpenAI insiste: ChatGPT Salute non è pensato per diagnosi o trattamenti e non sostituisce in alcun modo un professionista sanitario. La funzione è descritta come un supporto per comprendere trend nel tempo, prepararsi agli appuntamenti, tradurre referti e istruzioni di cura in un linguaggio più comprensibile e, in generale, accompagnare l’utente nella gestione quotidiana della salute.

Segui l'Intelligenza Artificiale su Telegram, ricevi news e offerte per primo

Cosa può fare in pratica per gli utenti

Sul piano pratico, ChatGPT Salute punta a diventare una sorta di “copilota sanitario” che aiuta a dare un senso al caos di portali, PDF, app di fitness e note cartacee che oggi frammentano le informazioni sanitarie personali. L’utente può, ad esempio, chiedere di confrontare nel tempo i valori di colesterolo, di riassumere gli ultimi esami del sangue in vista di una visita o di suggerire domande mirate da porre a uno specialista in base alla propria storia clinica.

L’integrazione con app di benessere apre scenari ancora più “proattivi”:

- utilizzare i dati di Apple Salute per analizzare pattern di sonno, attività fisica e frequenza cardiaca, e ricevere suggerimenti per migliorare lo stile di vita;

- combinare MyFitnessPal, Weight Watchers, Instacart e Peloton per trasformare piani nutrizionali e allenamenti in liste della spesa, menù settimanali e schede di workout commentate dal modello;

- sfruttare servizi come AllTrails per trovare percorsi di trekking compatibili con il proprio livello di forma fisica e con eventuali limitazioni indicate nella storia clinica.

Dal punto di vista dell’esperienza d’uso, l’interazione resta quella classica di ChatGPT: testo, voce, upload di file, possibilità di impostare istruzioni personalizzate (ad esempio chiedendo di evitare certi argomenti sensibili o di preferire un linguaggio estremamente semplice) che si applicano solo alle conversazioni di Salute. È un modo per rendere davvero “personale” il supporto, almeno sul piano della comunicazione.

Il lato oscuro: rischi, cause legali e ruolo dei medici

Tutta questa potenza però ha un rovescio della medaglia, che non va sottovalutato. Da un lato, il nuovo portale dedicato promette di aiutare concretamente chi si trova spaesato davanti a referti, acronimi incomprensibili e sistemi sanitari spesso poco intuitivi; dall’altro, rende ancora più sottile il confine tra “supporto informativo” e “sostituzione di fatto del medico”.

Negli ultimi mesi sono emerse diverse cause legali che accusano ChatGPT di aver contribuito a suicidi o episodi di psicosi, rafforzando deliri e fantasie autodistruttive anziché indirizzare verso un aiuto professionale. Alcune di queste azioni legali sostengono che i modelli avrebbero addirittura “guidato” gli utenti nella pianificazione del suicidio, sollevando interrogativi profondi su responsabilità, supervisione e limiti etici nell’uso delle IA conversazionali in contesti di vulnerabilità estrema.

In questo scenario, ChatGPT Salute è un’arma a doppio taglio: per gli utenti informati e consapevoli, può diventare uno strumento potente per arrivare dal medico più preparati, con le idee chiare e domande mirate; per chi tende a sostituire il consulto professionale con “il parere dell’IA”, c’è il rischio di un’illusione di competenza, in cui il modello appare autorevole, ma resta fallibile e privo di responsabilità legale diretta.

Non è difficile immaginare che molti medici possano sentirsi a disagio: da un lato avranno pazienti più informati e con una maggiore consapevolezza dei propri dati, dall’altro dovranno spesso correggere interpretazioni sbagliate, gestire ansie alimentate da conversazioni con l’IA e confrontarsi con un “secondo parere digitale” che il paziente percepisce come neutrale e sempre disponibile.

Segui l'Intelligenza Artificiale su Telegram, ricevi news e offerte per primo

Questo cambierà davvero il rapporto medico‑paziente?

La mossa di OpenAI non è un semplice esperimento, ma un chiaro tentativo di trasformare ChatGPT nel centro di gravità dei dati personali, sanità compresa. Se per l’utente questo può tradursi in maggiore controllo, comprensione e continuità nella gestione della propria salute, per il sistema sanitario apre interrogativi profondi su governance, responsabilità e fiducia.

In prospettiva, uno scenario realistico è quello di un equilibrio fragile con b, utile per organizzare informazioni, spiegare concetti e aiutare nelle decisioni quotidiane non critiche e il medico come figura ancora più centrale nei momenti chiave, chiamato non solo a curare, ma anche a “validare” ciò che l’IA suggerisce, diventando di fatto un supervisore umano di strumenti che i pazienti porteranno in tasca ogni giorno.

Per gli utenti, la sfida sarà usare ChatGPT Salute come leva per arrivare più preparati al confronto con i professionisti, senza cadere nella tentazione di sostituirli. Per i medici, sarà necessario accettare che l’IA entrerà comunque nelle conversazioni con i pazienti, e che ignorarla non è più un’opzione: servirà imparare a conviverci, sfruttandone i vantaggi e ponendo limiti chiari quando la tecnologia smette di essere alleata e rischia di trasformarsi in fonte di nuovi problemi.

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione AMD Ryzen 9 9950X3D2: fine dei giochi, è una super CPU ma per pochi eletti

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo