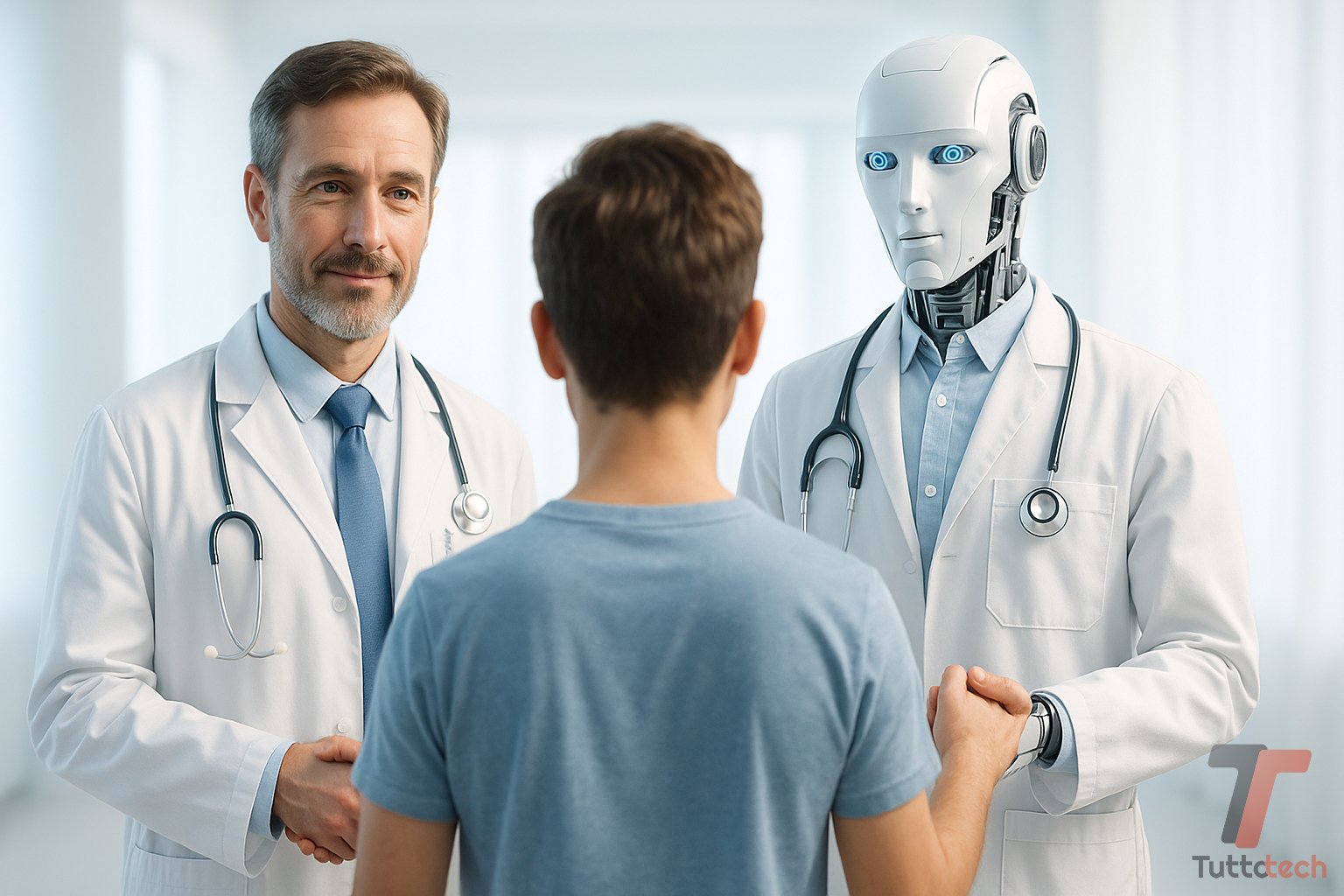

L’AI promette diagnosi più rapide, farmaci su misura, terapie personalizzate. Ma la vera domanda è: possiamo davvero affidarci a una macchina per curarci? Se nell’arte generativa la questione era “chi è l’autore”, in medicina la posta in gioco è più radicale: si tratta della fiducia, del rapporto di cura, della responsabilità.

L’intelligenza artificiale non è solo un nuovo strumento tecnologico: è un attore che si insinua nella relazione più delicata che conosciamo, quella tra medico e paziente.

Progressi concreti, promesse dell’AI in medicina e qualche ombra

Negli ultimi anni, sistemi di AI hanno mostrato progressi impressionanti. Algoritmi di deep learning sono in grado di leggere radiografie, TAC e risonanze con livelli di accuratezza comparabili – in alcuni casi superiori – a quelli di radiologi esperti. Modelli multimodali integrano immagini, dati clinici e sequenze genomiche per anticipare l’insorgenza di malattie. Strumenti di Natural Language Processing (NLP) analizzano cartelle cliniche elettroniche e letteratura biomedica per supportare i medici nel prendere decisioni più rapide e informate.

Ma ogni promessa porta con sé un’ombra. Come ricordato nell’articolo “Quando l’intelligenza artificiale discrimina”, i bias nei dataset possono generare distorsioni gravi. Se i dati di addestramento riflettono una popolazione prevalentemente maschile o bianca, le diagnosi per donne o minoranze possono risultare meno accurate. La maggior parte dei sistemi funziona come una “scatola nera”: produce risultati senza spiegazioni chiare. Se un algoritmo sbaglia, chi risponde? Il medico? L’azienda sviluppatrice? L’ospedale?

Riformulare la fiducia nella relazione di cura

La relazione di cura si basa sulla fiducia nel giudizio e nell’ascolto del medico. Introdurre un algoritmo non significa solo aggiungere uno strumento, ma ridisegnare quel rapporto. Il paziente accetterà una diagnosi solo se confermata da un medico? Il medico può limitarsi a validare l’AI o dovrà mantenere un ruolo critico?

Negare le potenzialità sarebbe miope. Sistemi di triage aiutano già oggi nei pronto soccorso. Algoritmi predittivi velocizzano la ricerca farmaceutica. Wearable e dispositivi IoT monitorano la salute in tempo reale. La sfida è integrare queste tecnologie senza sacrificare trasparenza, equità e relazione umana.

Se da un lato l’AI promette diagnosi più rapide e cure personalizzate, dall’altro porta con sé una serie di criticità che non possiamo ignorare. Si tratta di questioni tecniche ed etiche che toccano la qualità dei dati, la trasparenza dei processi decisionali e la tutela dei diritti fondamentali dei pazienti. Proprio qui si gioca il confine tra un’innovazione capace di rafforzare la medicina e una tecnologia che rischia di incrinarne le basi. Criticità che possiamo sintetizzare in:

- Bias e disuguaglianze: dataset incompleti accentuano discriminazioni.

- Opacità e responsabilità: difficile attribuire colpe o validare decisioni.

- Privacy e sicurezza: i dati sanitari sono sensibili, spesso gestiti da aziende private.

- Governance: l’AI Act impone regole, ma la sanità resta un ambito complesso.

Segui l'Intelligenza Artificiale su Telegram, ricevi news e offerte per primo

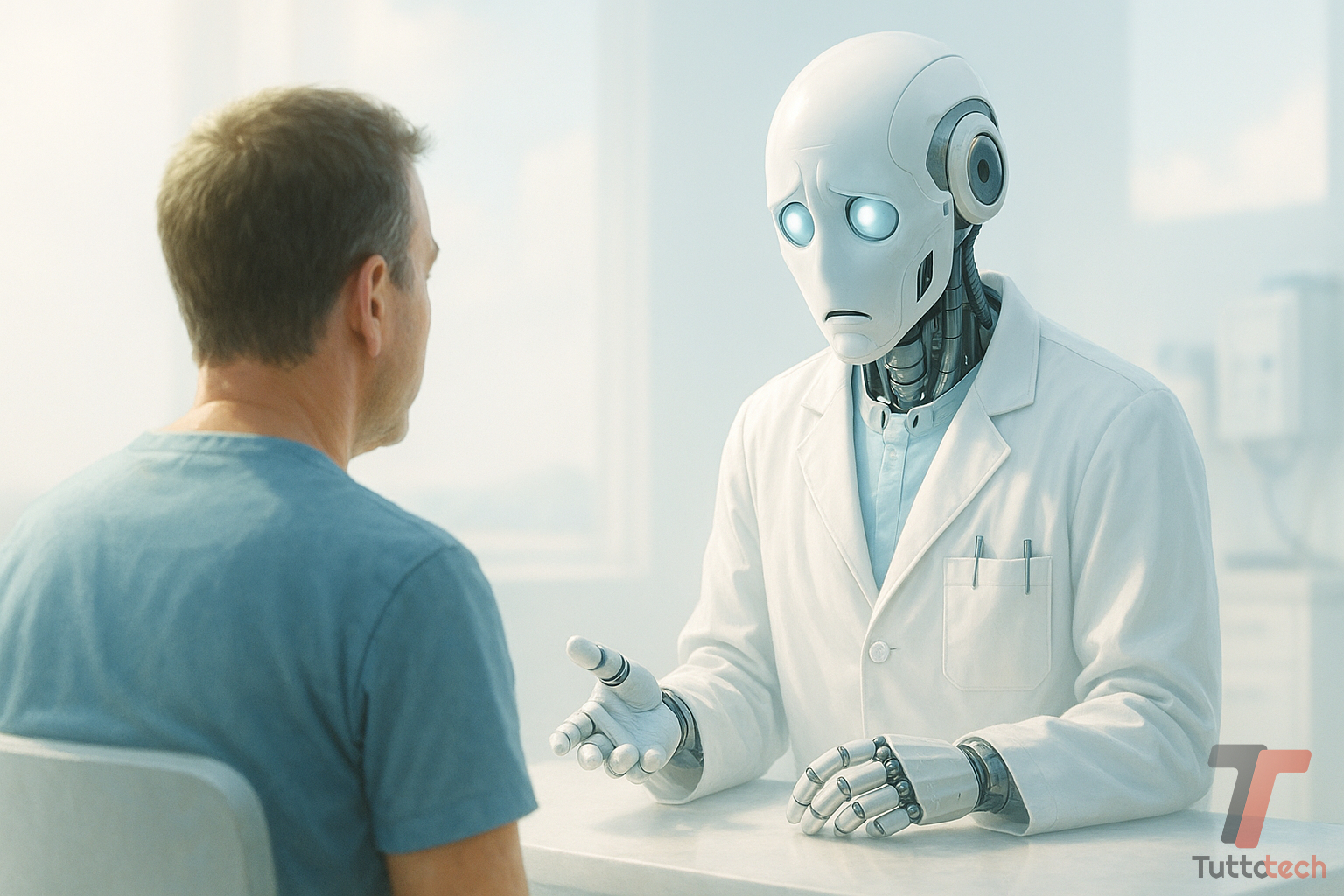

Empatia, ascolto e trasparenza: ciò che l’AI non può fare

L’AI può certamente potenziare la medicina, ma non potrà mai sostituire ciò che rende la cura autentica: l’empatia, la responsabilità, la capacità di ascolto. Un algoritmo può riconoscere pattern invisibili all’occhio umano, ma non può cogliere la sfumatura di una paura, la storia personale che si riflette in un sintomo, il bisogno di essere rassicurati oltre che trattati.

La tecnologia deve quindi essere considerata come un supporto, uno strumento di precisione che integra le competenze umane, non come un oracolo infallibile cui delegare la decisione finale. Perché ciò accada servono regole chiare: standard condivisi per certificare la qualità dei sistemi, procedure di audit indipendenti per valutarne l’affidabilità, garanzie sulla protezione dei dati che alimentano questi strumenti.

Occorrono sistemi trasparenti, capaci di spiegare non solo l’esito ma anche il processo che porta a una diagnosi algoritmica, così da consentire al medico di esercitare il proprio ruolo critico. Ma soprattutto serve una consapevolezza culturale: in sanità più che altrove, l’automazione non può ridurre l’umano a un dettaglio accessorio. La relazione di cura resta un atto profondamente umano, in cui la tecnologia è chiamata a servire, non a sostituire. Solo tenendo fermo questo principio sarà possibile coniugare innovazione e dignità della persona, evitando che l’efficienza si trasformi in disumanizzazione.

La prossima tappa della nostra riflessione sarà dedicata a un altro snodo cruciale: i dati. Perché se in medicina la domanda è “possiamo affidarci a una macchina per curarci?”, nella società digitale il quesito diventa ancora più radicale: “sappiamo davvero cosa cediamo e a chi, quando forniamo i nostri dati?”.

Ci occuperemo di come queste informazioni vengano raccolte – spesso attraverso tecniche di scraping invisibili agli utenti – e di quanto sia fragile il consenso che prestiamo. Metteremo a fuoco i diritti digitali che dovrebbero tutelarci e, soprattutto, la necessità di una nuova trasparenza nell’uso dei dati che alimentano l’intelligenza artificiale. Perché i dati siamo noi, ma troppo spesso non lo sappiamo.

L’intelligenza artificiale è ormai ovunque: nei motori di ricerca, nei social, nei software che usiamo per lavorare, curarci, decidere. Ma siamo davvero pronti a convivere con algoritmi che imparano, decidono, ci osservano?

Questa rubrica nasce per esplorare, con uno sguardo critico e accessibile, le sfide etiche e sociali dell’AI: dalle discriminazioni nei dati al lavoro che cambia, dalla creatività generativa alla privacy, fino al ruolo dell’umano in un mondo sempre più automatizzato.

Ogni settimana, un breve approfondimento per capire meglio cosa c’è dietro la tecnologia che ci cambia. E per iniziare a domandarci, tutti: dove vogliamo andare?

Puoi seguire la rubrica mettendo fra i preferiti la pagina che raccoglierà le varie puntate: Etica AI, oppure se utilizzi un aggregatore di notizie aggiungendo il Feed RSS di TuttoTech o più nello specifico il Feed RSS della rubrica Etica e AI.

Giovanni Di Trapani, ricercatore del CNR, economista, statitstico ed autore. Si occupa di innovazione, governance pubblica e futuro digitale. Gestisce il sito AIgnosi.it.

I nostri contenuti da non perdere:

- 🔝 Importante: Sottili e potenti, c’è un notebook per tutti con i nuovi MSI Prestige AI con Intel® Core™ Ultra: guida all’acquisto

- 🚨 I migliori Notebook MSI Prestige, adatti per ogni esigenza

- 💻 La prova di Reolink Home Hub: un sistema di video-sorveglianza in locale, affidabile ed economico

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo