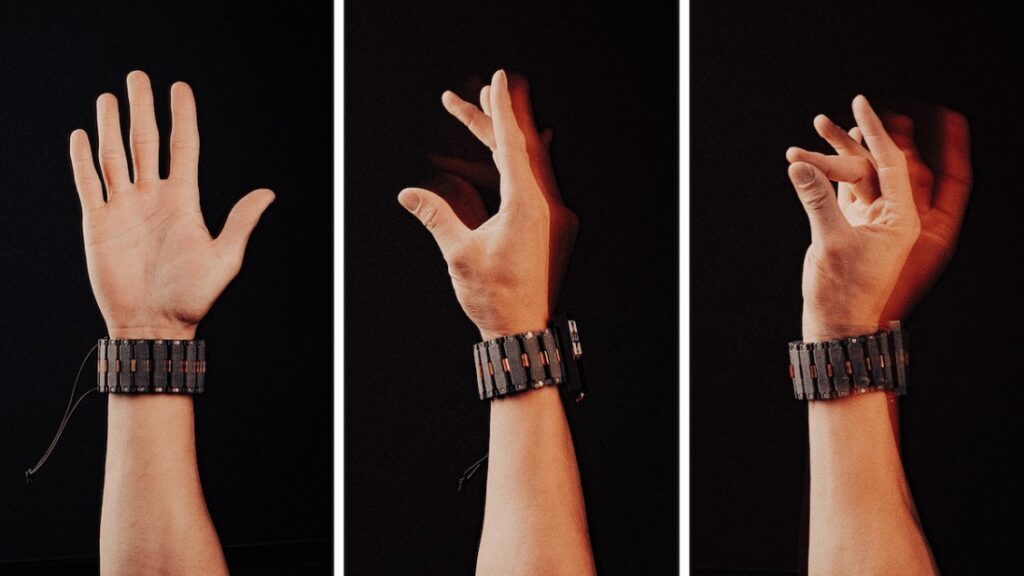

Per decenni abbiamo imparato a utilizzare tastiere, mouse, touchscreen e comandi vocali per comunicare con i nostri dispositivi; strumenti potenti certo, ma mai davvero naturali. Ora però, grazie alla nuova ricerca di Meta Reality Labs pubblicata su Nature, si apre la strada verso un’interazione più fluida, discreta e soprattutto umana: parliamo del braccialetto sEMG, capace di decodificare i movimenti muscolari del polso per controllare computer, smartphone e dispositivi AR.

Il braccialetto sEMG di Meta permetterà un controllo quasi invisibile dei dispositivi

Il cuore di questa nuova tecnologia è l’elettromiografia di superficie, o sEMG, una tecnica non invasiva che rileva segnali elettrici generati dai muscoli; applicata al polso questa tecnologia permette di leggere l’intenzione di eseguire un gesto prima ancora che esso venga completato, un tocco, uno swipe, un pizzico, tutto senza muovere realmente la mano, o quantomeno senza staccarla dal fianco.

Non si tratta solo di teoria, Reality Labs ha già sviluppato un prototipo funzionante di questo braccialetto, integrato con Orion, i primi occhiali AR di Meta; il risultato? Si possono scrivere messaggi nell’aria, navigare tra i menù virtuali o annotare qualcosa su un tavolo o sulla gamba, come se fosse un blocco note, senza dover mai abbassare lo sguardo sullo smartphone.

Uno degli aspetti più interessanti di questa tecnologia è la sua inclusività, non richiede calibrazioni specifiche e funziona su una vasta gamma di utenti, indipendentemente da età, corporatura o capacità fisiche. Le reti neurali che alimentano il sistema sono state infatti addestrate su oltre 100 ore di dati provenienti da più di 300 persone, e sono capaci di adattarsi ulteriormente nel tempo migliorando fino al 16% con una personalizzazione minima.

Un aspetto che si rivela particolarmente rilevante per le persone con disabilità motorie, come dimostrano i test condotti in collaborazione con la Carnegie Mellon University su utenti con lesioni spinali; anche chi soffre di paralisi completa delle mani mostra comunque una certa attività muscolare, e proprio quei segnali residui possono essere interpretati dal braccialetto sEMG per restituire un controllo funzionale del computer, senza bisogno di soluzioni invasive come gli impianti neurali Neuralink o le cuffie EEG, spesso limitate da scarsa precisione e interferenze ambientali.

Il grande vantaggio di questa tecnologia, oltre al suo potenziale esclusivo, è la sua immediatezza e discrezione, a differenza dei comandi vocali che possono risultare scomodi o inopportuni in ambienti pubblici o rumorosi, il braccialetto sEMG funziona sempre, senza richiedere attenzione visiva o accessori ingombranti; in altre parole, l’interazione con il mondo digitale diventa trasparente, adattandosi ai nostri gesti naturali piuttosto che costringerci ad adattarci a loro.

Se tutto questo vi sembra futuristico, sappiate che Meta ha pubblicato il proprio lavoro scientifico su Nature, mettendo a disposizione della comunità anche un ampio dataset open-source; un gesto che conferma l’intenzione di accelerare lo sviluppo di nuove soluzioni HCI (Human-Computer Interaction) anche da parte di terzi, creando le basi per un ecosistema accessibile e condiviso.

Il braccialetto sEMG di Meta potrebbe rappresentare un autentico punto di svolta nel modo in cui interagiamo con i nostri dispositivi, semplice da usare, estremamente preciso e soprattutto non invasivo, questo approccio apre nuove prospettive sono solo per l’AR e la produttività, ma anche e soprattutto per l’accessibilità.

Non sappiamo ancora se e quando vedremo un prodotto commerciale basato su questa tecnologia, ma i presupposti ci sono tutti; Meta ha mostrato che il futuro dell’interazione non passa necessariamente da impianti cerebrali o visori ingombranti, potrebbe essere già al nostro polso pronto per rispondere a un gesto invisibile.

I nostri contenuti da non perdere:

- 🔝 Importante: Recensione Amazfit Active 3 Premium: elegante e curato, con un prezzo democratico

- 🚨 Vuoi un notebook gaming serio senza spendere troppo? MSI Cyborg 15 con RTX 5060 è la risposta

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo